HappyHorse AI 是什么?现状、能力与 Prompt 机会全解析

HappyHorse-1.0 之所以在 AI 视频圈迅速走红,不是因为大家已经真正掌握了它,而是因为它在早期榜单和行业讨论里突然出现,吸走了大量注意力。问题在于:公开入口、官方文档和稳定的 prompt 资料仍然有限,用户的兴趣增长速度远快于可执行经验的积累速度。

目前能相对稳妥地说什么

更稳妥的表述是:HappyHorse 是一个在公开讨论中被频繁提到的视频模型,外部报道普遍强调它在文生视频、图生视频以及音画同步方面的早期表现。

但这不代表互联网上流传的每个技术细节都已被官方确认。对于内容和 SEO 页面,最好使用“公开报道显示”“行业讨论认为”“早期评测中出现”这类措辞,而不是把所有传闻当成确定事实。

为什么模型火了,创作者还是不会用

一个新模型爆火,往往先有关注度,后有方法论。创作者马上就想要可复用的 prompt 模板、案例和写法,但新模型最缺的恰恰就是这些。

所以真正的瓶颈不是热度,而是翻译能力:如何把一条你觉得厉害的视频,拆成自己能复用的提示词结构。

为什么“从视频反推”更实用

当模型本身还没有广泛开放时,参考视频反而是更稳定的事实来源。你可以直接观察镜头节奏、主体动作、光线、环境音和镜头切换,而不需要等待不完整的官方 prompt 文档。

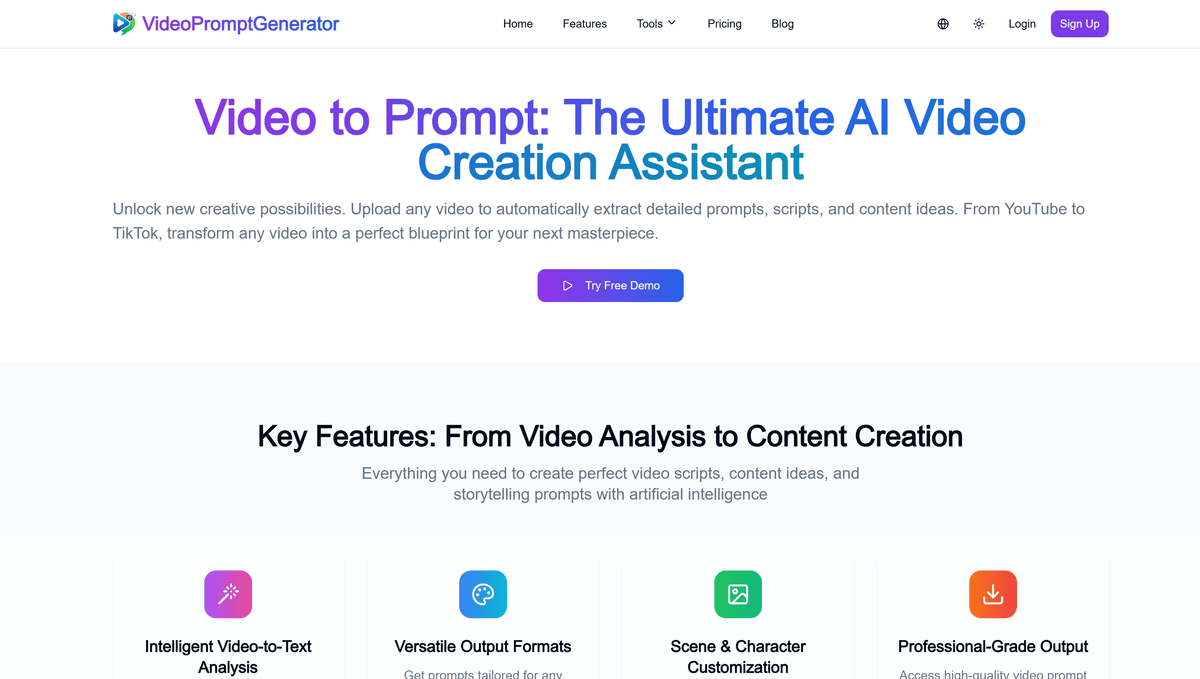

这也是 video-to-prompt 工作流真正有价值的地方。不是凭空猜词,而是先从真实视频提取结构,再把结构转成可测试、可迭代、可迁移的提示词蓝图。

一条好参考视频应该拆哪些字段

对大多数商业短片和电影感镜头来说,最值得提取的是主体、动作、场景、镜头感觉、机位运动、节奏、光线、氛围和音频线索。这些字段最容易影响最终生成结果。

重点不是逐字复制结果,而是抓住产出这个结果的生成结构。

做热点内容时要避开的坑

不要暗示自己已经有官方 HappyHorse 接入,不要把未经证实的架构细节写成定论,也不要承诺产品做不到的兼容能力。

更稳妥也更长期的定位其实很简单:在生态尚未成熟时,帮助用户从真实视频中更快地得到更好的提示词。